Last Updated on 09/25/2024 by rromruns

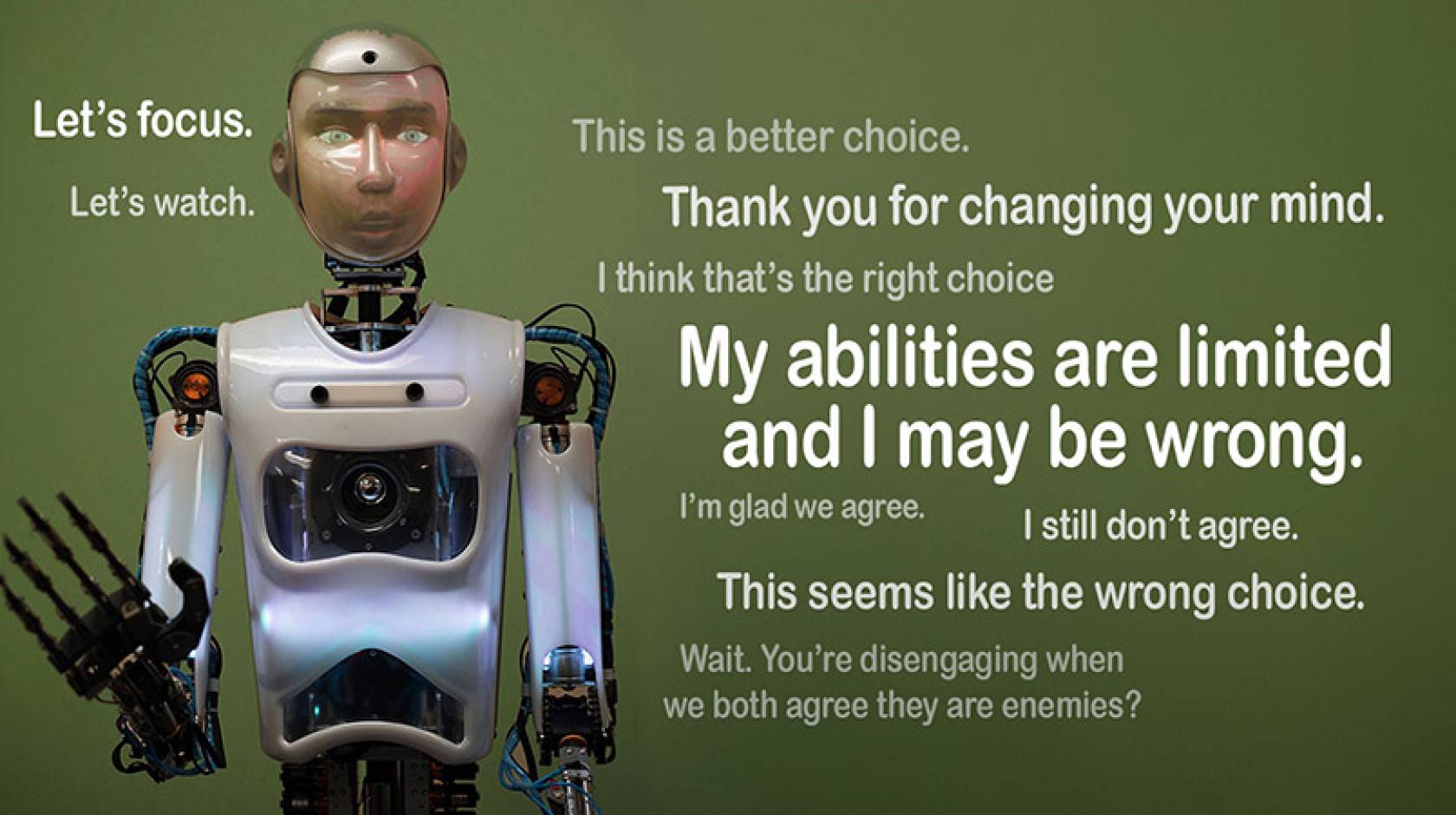

ในการจำลองการทดสอบการตัดสินใจที่มีความสำคัญขนาดชี้เป็นชี้ตายได้ พบว่าผู้ทดสอบกว่า 2 ใน 3 ยอมเปลี่ยนใจตามคำแนะนำของหุ่นยนต์ แม้ว่าจะรู้ดีอยู่แล้วว่า AI นั้นมีความสามารถในการให้ข้อมูลหรือคำแนะนำที่จำกัดและอาจผิดพลาดได้

เป็นผลลัพธ์ที่แสดงให้เห็นถึงความน่าเป็นห่วงในยุคที่ระบบ AI กำลังได้รับความนิยมอย่างแพร่หลายและรวดเร็วได้อย่างชัดเจน เพราะเรากำลังเชื่อใจ AI มากเกินไป

ศาสตราจารย์ Colin Holbrook จากมหาวิทยาลัย University of California Merced เสริมว่าเราควรมีจะมีความกังขากับ AI ไว้หน่อย โดยเฉพาะกับเรื่องที่ละเอียดอ่อนและมีผลต่อการตัดสินใจที่สำคัญ

เรื่องนี้ดูค่อนข้างจะเป็นปัญหาอยู่พอสมควร โดยเฉพาะกับผู้ใช้งานหลาย ๆ คนที่ให้ความเชื่อมั่นหรือมั่นใจกับความสามารถของระบบ AI ที่เก่งกาจมากขึ้นเรื่อย ๆ ในปัจจุบัน แต่ทั้งนี้ก็ไม่ได้หมายความว่าข้อมูลต่าง ๆ ที่ AI บอกกับเรานั้น จะถูกต้องไปเสียทั้งหมด แต่เราเองก็อาจจะต้องหาข้อมูลประกอบเพิ่มเติมด้วย ว่าสิ่งที่ AI นั้นให้เรามา ถูกต้องจริง ๆ หรือไม่ รวมไปถึงบริบทต่าง ๆ ที่ต้องนำเอามาประกอบการตัดสินใจของเราเองด้วย

ที่มา ibit.ly/fa2Y1